自由度(じゆうど)は、統計学において非常に重要な概念です。特にカイ二乗検定やt検定などの統計手法において、自由度の理解は不可欠です。

ここでは、自由度の定義や求め方、いくつかの具体例を通じてその意味を明確にしていきます。

自由度とは

自由度とは、自由に選択できる値の数を指し、統計分析において非常に重要です。一般的な定義は次の通りです。

「自由度は、観測されたデータの中で、独立して値を決めることができるデータの数です。」

自由度の求め方

自由度の計算方法は、使用する統計手法によって異なります。以下にいくつかの具体例を示します。

カイ二乗検定の場合

カイ二乗検定における自由度は、次の式で計算されます:

$$ df = (m – 1) \times (n – 1) $$

ここで、mは行の数、nは列の数です。この式の意味を理解するためには、事象の組み合わせを考えることが重要です。

t検定の場合

t検定の自由度は、通常次のように表されます:

$$ df = n – 1 $$

ここで、nはサンプルサイズです。これにより、標本のばらつきを考慮した検定が行えます。

自由度の重要性

自由度は統計的検定の結果に大きく影響を与えます。たとえば、自由度が小さいと、結果の信頼性が低下しやすくなります。以下のような例で考えてみましょう。

「自由度が小さいと、p値も変動しやすくなるため注意が必要です。」

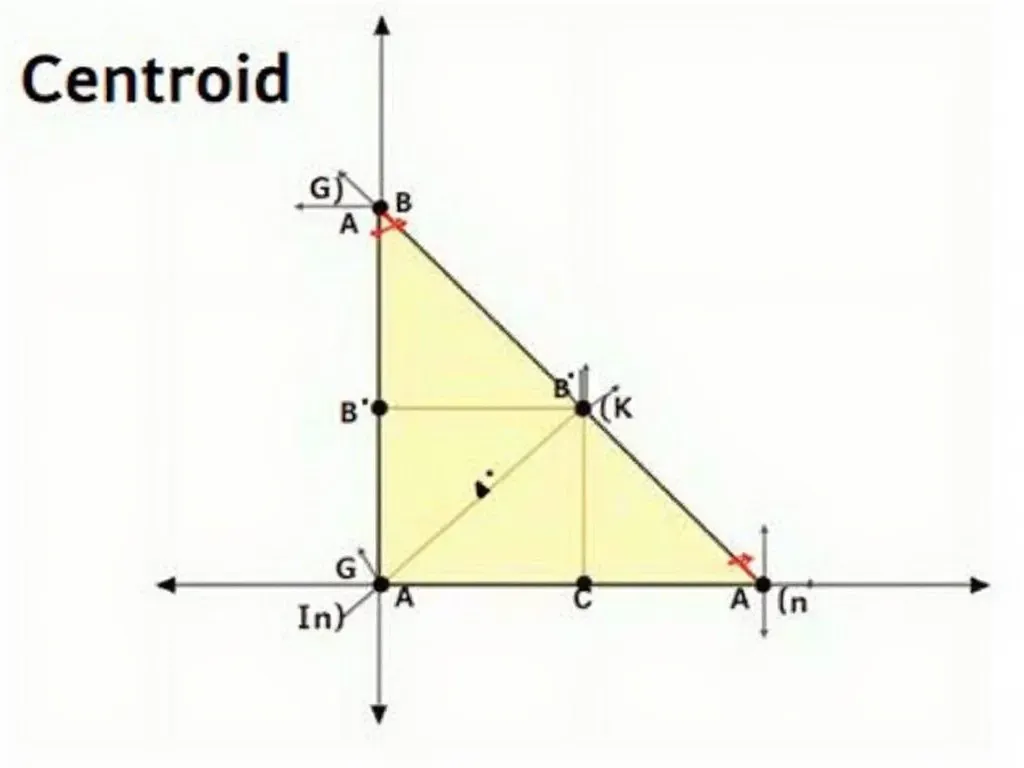

図で見る自由度

まとめ

自由度の概念は、統計学において非常に重要です。

特にカイ二乗検定やt検定を行う際には、次の点に留意してください:

df = (m - 1) × (n - 1) // カイ二乗検定の自由度

df = n - 1 // t検定の自由度

これらの式を理解し、自由度を適切に計算することが、正確な統計分析の第一歩です。興味のある方は、ぜひ実際のデータを使って、自由度の計算を体験してみると良いでしょう。